|

|

python有各种库的支持,写起爬虫来十分方便。刚开始学时,使用了标准库中的urllib, urllib2, re,还算比较容易,后来使用了bs4和requests的组合,感觉就更加方便快捷了。

本文中urllib库用于封装HTTP post的数据,它里面还有很多方法,如urllib.urlretrieve可以接收url对于的图片或视频文件;urllib2库中,urllib2.Request(url, data, headers)用于设置请求的头部,传输的数据等,urllib2.urlopen用于打开请求,获取返回数据,还可以设置超时时间,避免等待时间过长;re库,用于从返回数据中提取自己想要的结果,常用的方法又search,match,findall等,具体正则匹配的知识可以google或百度。

我的python版本是2.7,2.x默认编码是ascii,会遇到很多编码问题,各个网页的编码也不尽相同,我们需要根据实际情况进行decode 和encode 。python3.x默认是unicode编码,编码问题少一些,但是对于gbk等编码的网页同样需要decode,encode等操作。对于具体的网页,我们可以通过浏览器打开网页源码,确定好编码。

以下我写的第一个爬虫:主要实现对目标url进行post访问,传递搜索关键字 'keyWord': '什么',获取搜索结果中的文章标题及对应的url链接,保存到本地文件中。网页是gbk编码的,所以在post访问时 'keyWord': '什么' 需要编码成gbk。

1 # coding:utf-8

2 import urllib

3 import urllib2

4 import re

5

6 #请求地址

7 url = 'http://www.chinagscourt.gov.cn/WebSearch/result.htm?site=lanzhou'

8 #设置请求头部

9 user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)'

10 headers = {'User-Agent': user_agent}

11 #封装post的数据

12 values = {'keyWord': '什么'.decode('utf-8').encode('gbk')}

13 data = urllib.urlencode(values)

14 #设置正则匹配模式

15 pattern = re.compile('<div class="list_tit">.*?<a href="(?P<url>.*?)".*?title=(?P<title>.*?)>',re.S)

16 try:

17 #设置请求

18 request = urllib2.Request(url, data, headers=headers)

19 #打开请求,获取返回结果

20 response = urllib2.urlopen(request)

21 content = response.read().decode('gbk').encode('utf-8')

22 #匹配得到想要的数据

23 items = re.findall(pattern,content)

24

25 except urllib2.URLError, e:

26 if hasattr(e, "code"):

27 print e.code

28 if hasattr(e, "reason"):

29 print e.reason

30 #写入文件

31 with open("item.txt","w") as f:

32 for item in items:

33 f.write(item[0]+';'+item[1]+'\n')

以下是代码执行后,item.txt中的结果:

1 ../zyDetail.htm?id=924739;"为什么有最高人民法院的批示,我的案子还是没人处理"

2 ../zyDetail.htm?id=152422;"什么是执行风险?"

3 ../zyDetail.htm?id=152426;"什么是先予执行?"

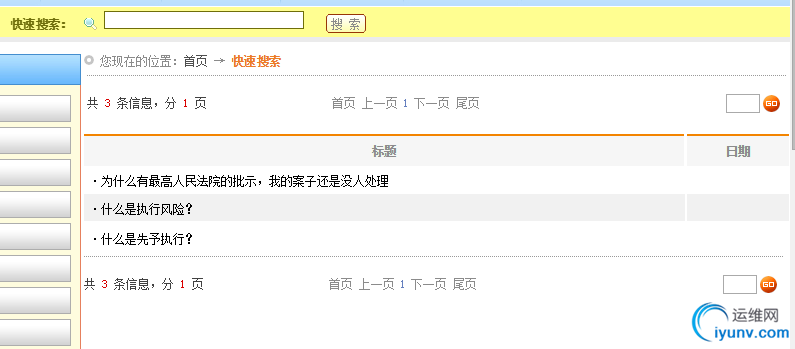

对比网页上输入 "什么" 后的搜索结果:

总结:现在来看自己当时写的第一个爬虫,感觉用urllib,urllib2,re做爬虫确实有点麻烦,同样的爬虫,用requsts 和bs4来做,要简单很多。此外,这个小爬虫对于返回结果是多页的情况没有考虑,有兴趣的同学可以继续实现。

题外话:逛博客园不到一年,很庆幸实习时的同事推荐了这里,让我了解了许多知识,注册后一直想自己也写写,可是总感觉自己这么菜能写什么,看了 你为什么不分享http://www.cnblogs.com/coffeedeveloper/p/4825177.html之后,感觉自己没必要顾忌那么多,之前看了很多技术博客,受益匪浅,现在稍微入门一点,希望也能帮上其它同学。

|

|

|