参考资料http://docs.ceph.org.cn/rados/operations/add-or-rm-osds/#id12

https://www.redhat.com

命令1. 所有节点上,防火墙,selinux等关掉,配置hostname与hosts文件,ntp同步;确保网络可达

setenforce 0

vim /etc/selinux/config #将selinux改成disable

systemctl stop firewalld

systemctl disable firewalld

hostnamectl set-hostname ceph1

vim /etc/hosts

192.168.10.100 ceph1

crontab –e

*/3 * * * * /usr/bin/ntpdate 0.rhel.pool.ntp.org

2. 在mon上,配置monitor(监控群集的)

ssh-keygen #创建公钥

ssh-copy-id root@192.168.10.100 #将公钥发给ceph集群的所有节点

yum install -y ceph-deploy #安装ceph-deploy工具自动部署ceph

mkdir /usr/local/ceph-cluster #新建一个部署ceph的目录

cd /usr/local/ceph-cluster/ #进入目录

ceph-deploy new hrr_ceph #新建一个ceph集群名字为hrr_ceph

ceph-deploy install ceph1 ceph2 ceph3--no-adjust-repos #在这个集群的主机安装ceph包

yum install -y ceph-mon #安装mon的包,如果用官方的yum,这不用装

ceph-deploy mon create ceph1 #创建monitor角色

ceph-deploy gatherkeys ceph #收集密钥

#进入ceph部署的目录

[iyunv@ceph ceph-cluster]# vim ceph.conf

public_network=172.25.2.0/24 #公共网络(心跳,用户访问)

cluster_network=172.24.2.0/24 #集群网络(osd之间复制)

osd_journal_size=1000

3. 在集群中的node(节点)都安装osd的包

yum install -y ceph-osd #安装osd的包,如果用官方的yum,这不用装

#将一个磁盘配置为osd

fdisk /dev/vdb #分区

mkfs -t xfs /dev/vdb1 #格式化

mkdir /mnt/osd #创建挂载点

echo "/dev/vdb1 /mnt/osd xfs defaults0 0" >> /etc/fstab #开机自动挂载

mount -a #挂载

df -TH #查看挂载

4. 集群中的node(节点),创建osd

ceph-deploy --overwrite-confosd prepare ceph:/mnt/osd #加为osd

ceph-deploy --overwrite-conf osd activate ceph:/mnt/osd #激活osd

ceph -s # -s, --status表show cluster status 查看ceph集群的状态

实验1.实验环境介绍

使用的笔记本配置:联想(i5的CPU,16G的内存,固态硬盘)

使用的虚拟化环境:12.0.0build-2985596

虚拟机配置:

内存2GB

CPU 2核

硬盘(SCSI) 20G(2块,系统盘和osd)

DVD光盘 rhel-server-7.1-x86_64-dvd.iso

网上 2块(桥接用于public network, host-only用于gluster network)

2.网络配置

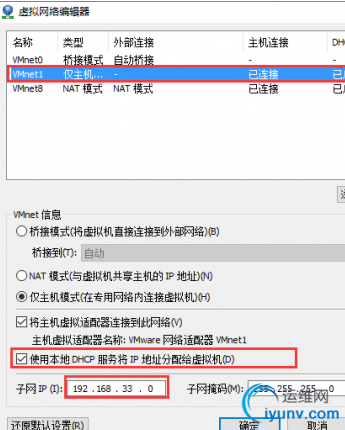

由于虚拟机的ntp服务器使用的是互联网的,而本人所在的wifi环境网段为192.168.10.0,所以将虚拟机的网卡1桥接到无线网卡并配置为DHCP模式(配置DHCP的好处防止IP冲突)。也就是说public network使用192.168.10.0/24这个网段 gluster network使用vmware的host-only网卡的网络,这里也将它配置成DHCP,就需要开启vmware里的网络配置的DHCP功能。这里将glusternetwork配置成192.168.33.0/24这个网段。

在vmware界面>编辑>虚拟网络编辑器

3.装系统,打快照,克隆

操作系统使用7.1的,最小化安装

装完系统后做基本的配置:

克隆后可能有些虚拟机网卡会有问题,将网卡文件删除,再通过mac地址新建网卡文件:

nmcli connection add type ethernet con-name eth0 ifname eth0 mac00:0c:29:71:b5:dd

4.执行上面的命令

|