配置SSH无密码配置。 (1-1)、进行sshd的配置文件的修改,去掉默认注释,开启SSH验证功能(以root用户进行操作)vim /etc/ssh/sshd_config

将上面的这三行数据的注释“#”去掉进行,保存。这里记住了!所有的机器都要这么依次进行设置。RSAAuthentication是指开启SSH验证,PubkeyAuthetication是指可以通过公钥进行验证,AuthorizedkeysFile则指的的是公钥存放的位置。

(1-2)、重启该服务:/sbin/service sshd restart

(1-3)、用本机验证一下:ssh localhost这个时候会让你输入密码,是因为没有生成密钥,下面进行设置

(2-1)、加工生成证书公私钥,分发到各个服务器(以Hadoop用户操作)在Master节点上生成Hadoop用户的公钥,然后将这个公钥分发给各个slave节点,然后这样在Master机器上就可以用Hadoop无密码登录到各个salve机器上面了

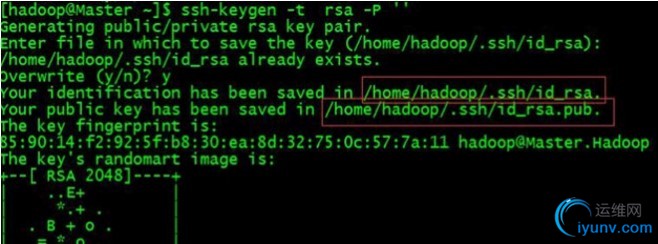

(2-2)、ssh-keygen -t rsa -P ''

红框勾出的路径就是公钥和私钥生成的默认路径

(2-3)、下一步就是将这个公钥复制到各个slave节点中去,远程文件的复制:scp ~/.ssh/id_rsa.pub 远程用户名@远程服务器IP:~/复制的公钥文件存在默认的路径“/home/hadoop/.ssh”scp ~/.ssh/id_rsa.pub hadoop@192.168.1.51:~/

(2-4)、登录salve01的机器将刚才生成的公钥加入的本地的权限验证组里面去cat ~/id_rsa.pub >> ~/.ssh/authorized_keys

(2-5)、回到Master机器上面进行,ssh验证SSH <远程IP && 域名>在master机器上登录slave01机器上实验下,看是否还需要进行密码输入ssh slave01.hadoop从Master机器上面无密码的登录到Slave01机器上面,那么说明刚才的配置生效了。

(2-6)、参照上面的步骤将各个Slave节点配置完成

(2-7)、注意:在Master生成密钥只需要生成一次就可以了,不要再次生成!因为每次生成以为着所有的节点都需要重新配置。

(2-8)、参照上面的步骤将各个Slave节点SSH到Master机器(保证各个Slave节点能够无密码登录Master机器,各个Slave子节点干完Master分配的任务之后,需要有权限反馈至Master)

注意:上面的步骤要一定完成验证,要不以后的Hadoop操作会很出现各种诡异的问题!!

(3-1)、配置Hadoop集群配置

将这个单节点的配置成一个真正的分布式集群,充分利用我们刚才搭建的几台Server进行性能的最大发挥

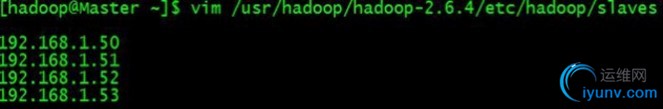

(3-2)、首先进行slaves文件的配置,指定该集群的各个Slave节点的位置(以hadoop用户进行操作)(只需要在Master的机器上面进行就可以了)vim /usr/hadoop/hadoop-2.6.4/etc/hadoop/slaves将各个Slave的IP或者机器名写入

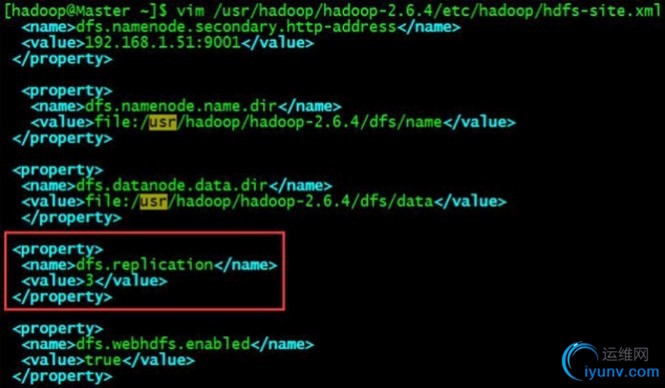

(3-3)、更改hdfs-site.xml文件中的dfs.replication属性值为3(因为有另外3台虚拟机,记住:只能是奇数!)vim /usr/hadoop/hadoop-2.6.4/etc/hadoop/hdfs-site.xml

(这里需要注意的是,所有的机器都要这样配置。)

(4-1)、启动Hadoop集群,验证是否成功

先来执行一个HDFS格式的命令(改成完全分布式的集群,所以这里需要重新格式)bin/hadoop namenode -format

(4-2)、验证一下整个集群的HDFS是否正常可用,启动整个集群的HDFS,在Master机器上面,用hadoop用户操作start-dfs.sh

通过浏览器来查看整个集群的HDFS状态,地址为:http://192.168.1.50:50070/dfshealth.html#tab-overview

(4-3)、验证一下整个集群的YARN分布式计算框架是否正常可用,启动Yarnstart-yarn.sh

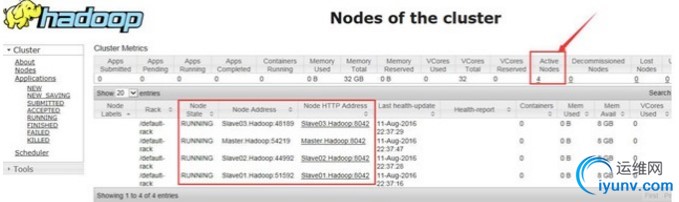

通过浏览器来查看整个集群的Hadoop集群状态,地址为:http://192.168.1.50:8088/

通过浏览器来查看整个集群的Hadoop集群状态,地址为:http://192.168.1.50:8088/

可见当前的Hadoop集群已经存在四个正在运行的节点。 |